امن المعلومات

التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني

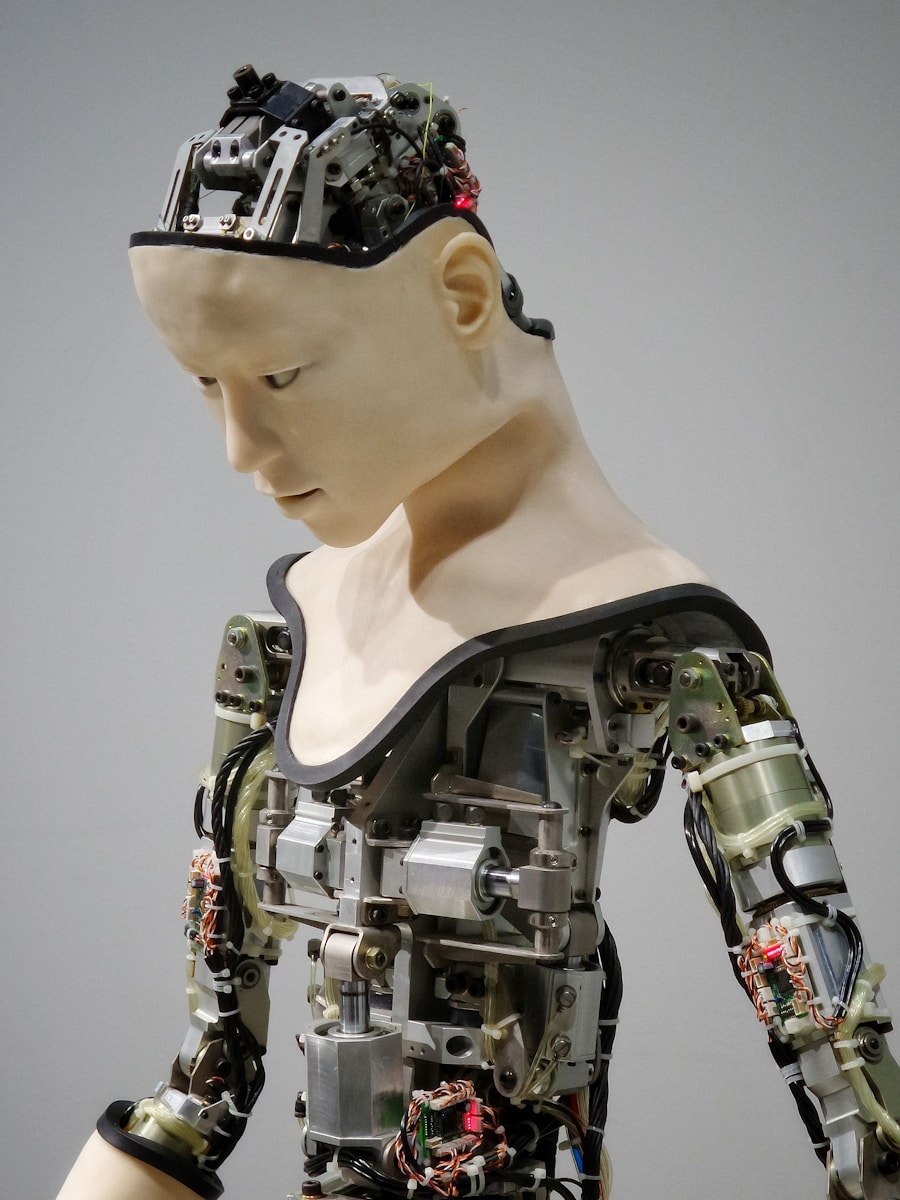

في عصرنا الحالي، أصبح الذكاء الصناعي جزءًا لا يتجزأ من العديد من المجالات، بما في ذلك الأمن السيبراني. ومع تزايد الاعتماد على هذه التكنولوجيا، تبرز مجموعة من التحديات الأخلاقية التي تتطلب منا التفكير العميق. إن استخدام الذكاء الصناعي في الأمن السيبراني يمكن أن يوفر حلولًا فعالة لمواجهة التهديدات المتزايدة، ولكنه أيضًا يثير تساؤلات حول كيفية استخدام هذه التكنولوجيا بشكل مسؤول وأخلاقي.

نحن بحاجة إلى فهم هذه التحديات بشكل شامل لضمان أن نستخدم الذكاء الصناعي بطريقة تعزز الأمان دون المساس بالقيم الإنسانية. تتراوح التحديات الأخلاقية من قضايا الخصوصية إلى العدالة، مما يجعل من الضروري أن نتناول هذه القضايا بجدية.

إن استخدام الذكاء الصناعي في تحليل البيانات الضخمة يمكن أن يؤدي إلى تحسينات كبيرة في الأمن، ولكنه قد يتسبب أيضًا في انتهاكات للخصوصية أو تمييز ضد مجموعات معينة.

لذلك، يجب علينا كأفراد ومؤسسات أن نكون واعين لهذه القضايا وأن نعمل على تطوير استراتيجيات تضمن الاستخدام الأخلاقي لهذه التكنولوجيا.

ملخص

- التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني تتطلب اهتماماً خاصاً وتحليلاً دقيقاً.

- يجب مراعاة أخلاقيات جمع البيانات والحفاظ على الخصوصية في استخدام الذكاء الصناعي في الأمن السيبراني.

- تحديات العدالة والتمييز تشكل تحدياً كبيراً في استخدام الذكاء الصناعي في الأمن السيبراني.

- يجب مراقبة تأثيرات الذكاء الصناعي على القرارات الأمنية ومعالجة التحديات الأخلاقية المتعلقة.

- الشفافية والمساءلة أمور أساسية في استخدام الذكاء الصناعي في الأمن السيبراني وتشكل تحدياً كبيراً.

أخلاقيات جمع البيانات والخصوصية في الذكاء الصناعي في الأمن السيبراني

أهمية حماية الخصوصية

يجب علينا أن نكون حذرين في كيفية جمع البيانات واستخدامها، حيث أن أي انتهاك للخصوصية يمكن أن يؤدي إلى فقدان الثقة بين الأفراد والمؤسسات. علاوة على ذلك، يجب أن نتذكر أن البيانات التي يتم جمعها قد تحتوي على معلومات حساسة يمكن أن تؤثر على حياة الأفراد.

لذا، يجب علينا وضع معايير واضحة لجمع البيانات واستخدامها، مع ضمان حماية حقوق الأفراد.

تطوير سياسات واضحة

إن تطوير سياسات واضحة وشفافة حول كيفية جمع البيانات واستخدامها يمكن أن يساعد في تعزيز الثقة بين المستخدمين والمطورين، مما يسهم في تحقيق توازن بين الأمان والخصوصية.

التوازن بين الأمان والخصوصية

يجب علينا أن نعمل على تحقيق توازن بين الأمان والخصوصية، حيث أن جمع البيانات يجب أن يتم بطريقة تخدم الأمان دون المساس بالخصوصية. يمكن أن يساعدنا ذلك في بناء ثقة أكبر بين الأفراد والمؤسسات، مما يسهم في تحقيق أمن سيبراني أكثر فعالية.

تحديات العدالة والتمييز في استخدام الذكاء الصناعي في الأمن السيبراني

تعتبر العدالة والتمييز من القضايا الرئيسية التي يجب أن نأخذها بعين الاعتبار عند استخدام الذكاء الصناعي في الأمن السيبراني. إن الأنظمة المعتمدة على الذكاء الصناعي قد تعكس التحيزات الموجودة في البيانات التي تم تدريبها عليها، مما يؤدي إلى نتائج غير عادلة. نحن بحاجة إلى أن نكون واعين لهذه التحديات وأن نعمل على تطوير نماذج ذكاء صناعي تأخذ بعين الاعتبار التنوع والشمولية.

عندما يتم استخدام الذكاء الصناعي لتحديد التهديدات أو اتخاذ قرارات أمنية، فإن أي تحيز قد يؤدي إلى استهداف مجموعات معينة بشكل غير عادل. لذلك، يجب علينا كمهنيين في هذا المجال أن نكون ملتزمين بتطوير تقنيات تعزز العدالة وتقلل من التمييز. يتطلب ذلك منا العمل على تحسين جودة البيانات المستخدمة وتطبيق أساليب تقييم دقيقة لضمان عدم وجود تحيزات تؤثر على النتائج.

تأثيرات الذكاء الصناعي على القرارات الأمنية والتحديات الأخلاقية المتعلقة

إن استخدام الذكاء الصناعي في اتخاذ القرارات الأمنية يمكن أن يكون له تأثيرات كبيرة على كيفية إدارة المخاطر والتعامل مع التهديدات. ومع ذلك، فإن هذه التأثيرات تأتي مع مجموعة من التحديات الأخلاقية التي يجب علينا التعامل معها. نحن بحاجة إلى التفكير في كيفية تأثير هذه القرارات على الأفراد والمجتمعات، وما إذا كانت هذه القرارات تعكس القيم الإنسانية الأساسية.

عندما نعتمد على الذكاء الصناعي لاتخاذ قرارات أمنية، يجب أن نكون حذرين من الاعتماد المفرط على التكنولوجيا دون النظر إلى العواقب المحتملة. إن اتخاذ قرارات تعتمد فقط على الخوارزميات قد يؤدي إلى تجاهل السياقات الإنسانية والاجتماعية التي تلعب دورًا مهمًا في فهم التهديدات. لذلك، يجب علينا أن نعمل على دمج الخبرة البشرية مع التكنولوجيا لضمان اتخاذ قرارات متوازنة تأخذ بعين الاعتبار جميع العوامل المعنية.

تحديات الشفافية والمساءلة في استخدام الذكاء الصناعي في الأمن السيبراني

تعتبر الشفافية والمساءلة من العناصر الأساسية التي يجب أن نتناولها عند الحديث عن استخدام الذكاء الصناعي في الأمن السيبراني. إن غياب الشفافية يمكن أن يؤدي إلى فقدان الثقة بين المستخدمين والمطورين، مما يؤثر سلبًا على فعالية الأنظمة الأمنية. نحن بحاجة إلى تطوير آليات تضمن وضوح العمليات والقرارات المتخذة بواسطة الذكاء الصناعي.

علاوة على ذلك، يجب أن نكون مستعدين لتحمل المسؤولية عن القرارات التي تتخذها الأنظمة المعتمدة على الذكاء الصناعي. إن تحديد المسؤوليات بوضوح يمكن أن يساعد في تعزيز الثقة ويضمن أن يتم التعامل مع أي انتهاكات أو أخطاء بشكل مناسب. نحن بحاجة إلى إنشاء إطار عمل يضمن الشفافية والمساءلة، مما يسهم في تعزيز الاستخدام الأخلاقي للذكاء الصناعي في الأمن السيبراني.

الأخلاقيات في استخدام الذكاء الصناعي في الحرب السيبرانية

الحاجة إلى تحديد الحدود الأخلاقية

إن استخدام هذه التكنولوجيا في الهجمات السيبرانية أو الدفاع عنها يثير العديد من القضايا الأخلاقية التي تتطلب منا التفكير العميق. نحن بحاجة إلى تحديد الحدود الأخلاقية لاستخدام الذكاء الصناعي في هذا السياق، وما إذا كان ينبغي علينا استخدامه كأداة للحرب.

العواقب المحتملة لاستخدام الذكاء الصناعي

عندما نتحدث عن الحرب السيبرانية، يجب أن نكون واعين للعواقب المحتملة لاستخدام الذكاء الصناعي. إن الهجمات التي تعتمد على هذه التكنولوجيا قد تؤدي إلى أضرار جسيمة للأفراد والبنية التحتية الحيوية.

الالتزام بتطوير سياسات واضحة

لذلك، يجب علينا كأفراد ومؤسسات أن نكون ملتزمين بتطوير سياسات واضحة تحدد كيفية استخدام الذكاء الصناعي في هذا السياق، مع التركيز على حماية حقوق الإنسان والقيم الأساسية.

التحديات الأخلاقية في تطوير وتحسين التقنيات الذكاء الصناعي في الأمن السيبراني

تطوير وتحسين تقنيات الذكاء الصناعي يتطلب منا التفكير في مجموعة من التحديات الأخلاقية التي قد تنشأ خلال هذه العملية. نحن بحاجة إلى التأكد من أن التقنيات التي نقوم بتطويرها تعكس القيم الإنسانية وتعزز الأمان دون المساس بالحقوق الأساسية للأفراد. إن الابتكار يجب أن يكون مصحوبًا بمسؤولية أخلاقية لضمان عدم استغلال هذه التقنيات بشكل غير صحيح.

علاوة على ذلك، يجب علينا كمهنيين في هذا المجال أن نكون ملتزمين بتطوير تقنيات تأخذ بعين الاعتبار التنوع والشمولية. إن تحسين تقنيات الذكاء الصناعي يتطلب منا العمل على تقليل التحيزات وضمان أن تكون النتائج عادلة وشاملة للجميع. لذلك، يجب علينا الاستثمار في البحث والتطوير لضمان أن تكون التقنيات التي نقوم بتطويرها متوافقة مع المعايير الأخلاقية.

خلاصة وتوصيات للتغلب على التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني

في الختام، نجد أن التحديات الأخلاقية المرتبطة باستخدام الذكاء الصناعي في الأمن السيبراني تتطلب منا التفكير العميق والعمل الجاد للتغلب عليها. نحن بحاجة إلى تطوير سياسات واضحة وممارسات مسؤولة تضمن الاستخدام الأخلاقي لهذه التكنولوجيا. إن تعزيز الشفافية والمساءلة والعدالة يجب أن يكون جزءًا أساسيًا من استراتيجياتنا.

نوصي بضرورة التعاون بين الحكومات والشركات والمجتمع المدني لتطوير إطار عمل شامل يضمن الاستخدام المسؤول للذكاء الصناعي في الأمن السيبراني. كما يجب علينا الاستثمار في التعليم والتوعية حول القضايا الأخلاقية المرتبطة بهذه التكنولوجيا لضمان فهم الجميع لأهمية الاستخدام الأخلاقي للذكاء الصناعي. من خلال العمل معًا، يمكننا تحقيق توازن بين الأمان والحقوق الإنسانية وتعزيز الثقة بين جميع الأطراف المعنية.

تتناول المقالة القادمة من موقع Lezrweb التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني. وتشير المقالة إلى أهمية التفكير بالأخلاقيات والتحديات التي قد تواجهنا في هذا المجال المتطور. لمزيد من المعلومات، يمكنك قراءة المقالة كاملة عبر الرابط التالي: التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني.

FAQs

ما هي التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني؟

تتضمن التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني قضايا مثل الخصوصية والتعرض للاختراق والتحكم في البيانات الشخصية والتمييز والتحيز في القرارات الآلية.

كيف يمكن التغلب على التحديات الأخلاقية في استخدام الذكاء الصناعي في الأمن السيبراني؟

يمكن التغلب على التحديات الأخلاقية من خلال وضع سياسات وقوانين صارمة لحماية البيانات الشخصية وضمان عدم التمييز في استخدام التقنيات الذكاء الصناعي وتعزيز الشفافية في عمليات اتخاذ القرارات الآلية.

ما هي الآثار السلبية المحتملة لاستخدام الذكاء الصناعي في الأمن السيبراني؟

من الآثار السلبية المحتملة لاستخدام الذكاء الصناعي في الأمن السيبراني هي احتمالية زيادة التعرض للاختراقات واستخدام التقنيات الذكاء الصناعي في القرارات الآلية بطريقة تؤدي إلى التمييز والظلم.

ما هي السبل المتاحة لضمان استخدام أخلاقي للذكاء الصناعي في الأمن السيبراني؟

يمكن ضمان استخدام أخلاقي للذكاء الصناعي في الأمن السيبراني من خلال تطبيق مبادئ الشفافية والمساءلة والعدالة في تطوير واستخدام التقنيات الذكاء الصناعي وتوفير التدريب والتوعية للمختصين في هذا المجال.

English

English